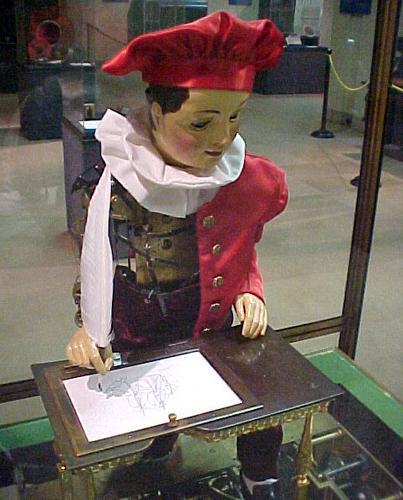

1- L'Intelligence Artificielle, Son histoire! Le fait que les objets inanimés pourraient avoir une pensée consciente est commun à beaucoup de mythologies de l'Antiquité. Ainsi, dans l'Iliade (chant XVIII), Héphaïstos, dieu du feu, avait construit des tables à trois pieds pour le servir ; dans la tradition juive, le Golem, automate à forme humaine, est animé par un rabbin, qui doit lui inscrire sur le front un mot magique pour qu'il le serve. Au XVIIème siècle, R. Descartes (mathématicien, physicien et philosophe français) introduit l'idée de l'"animal-machine", qui aurait certaines activités humaines, mais pas toute l'intelligence et en tout cas ni conscience ni pensée. Descartes pense que l'homme pourra un jour créer une machine qu'on ne pourra différencier d'un animal. En 1747, J. de La Mettrie publie "L'homme-machine": il étend à l'homme le principe de Descartes de l'animal-machine, en ayant l'intuition que cette distinction homme-animal ne tient pas, sans pouvoir expliquer le comportement de l'homme. Au même moment, on voit apparaître, (notamment œuvres de Vaucanson), les premiers automates, qui cherchent à reproduire les mouvements et les attitudes d'un homme ou d'un animal (un joueur de flûte, un canard qui mange, digère, cancane et simule la nage).  Ainsi, un automate dessinateur et écrivain, possédant une mémoire mécanique (la plus grande, d'ailleurs, jamais réalisée), qui contient trois poèmes et quatre dessins ; l'automate peut les reproduire à l'aide d'un crayon et sur un papier, et même les enchaîner. Il fonctionne toujours à l'heure actuelle et a même inspiré Martin Scorsese pour son film « Hugo Cabret », sorti en fin d'année dernière. Ainsi, un automate dessinateur et écrivain, possédant une mémoire mécanique (la plus grande, d'ailleurs, jamais réalisée), qui contient trois poèmes et quatre dessins ; l'automate peut les reproduire à l'aide d'un crayon et sur un papier, et même les enchaîner. Il fonctionne toujours à l'heure actuelle et a même inspiré Martin Scorsese pour son film « Hugo Cabret », sorti en fin d'année dernière. L'arrivée des ordinateurs électroniques, dans les années 1940, va être une étape importante. En 1943, Pitts et McCulloch modélisent des neurones formels (représentation mathématique et informatique d'un neurone biologique). En s'appuyant sur les propriétés des neurones biologiques connues à cette époque, à la suite d'observations neurophysiologiques et anatomiques, ces derniers proposent un modèle simple de neurone formel: s'agissant d'un neurone binaire, c'est-à-dire dont la sortie vaut 0 ou 1. C'est Alan Turing, un mathématicien britannique, qui a commencé à évoquer "l'intelligence artificielle" en 1950 puisqu'il est l'inventeur du test portant son nom. en octobre 1950, le test de Turing (test d'intelligence artificielle ayant la faculté d'imiter la conversation humaine) est fondé sur la capacité d'imiter la conversation humaine. C'est alors la première proposition de test d'intelligence artificielle ! Ce dernier est la confrontation verbale entre un humain et un ordinateur et un autre humain à l'aveugle. L'objectif étant de savoir si l'homme est capable de faire la différence entre l'ordinateur et l'autre homme : si l'homme, qui engage les conversations, n'est pas capable de dire lequel de ses interlocuteurs est un semblable et l'autre, un ordinateur, le logiciel de la machine a passé le test avec succès. Pour que le test soit universel, la conversation est limitée à un échange textuel entre les acteurs. Anecdote : Turing s'est inspiré d'un jeu d'imitation dans lequel un homme et une femme vont dans des pièces distinctes et les invités tentent de discuter avec les deux protagonistes en écrivant des questions et en lisant les réponses qui leur sont renvoyées. Dans ce jeu l'homme et la femme essayent de convaincre les invités qu'ils sont tous deux des femmes. Le terme « Intelligence Artificielle » est né en août 1956 lors d'un congrès à l'université de Dartmouth (ville de Hanover, état du New Hampshire, USA). Une communauté d'été réunit un groupe de jeunes chercheurs doués d'un projet exaltant : celui de fonder un nouvel enseignement scientifique: l'Intelligence Artificielle. Sont présents, à cette conférence, le mathématicien John MC Carthy, inventeur du terme IA, Herbert A. Simon, théoricien des organisations et futur prix Nobel d'économie, ainsi que les mathématiciens Allen Newel et Marvin Minsky ; et Claude Shannon, le père de la théorie de l'information. Dans les années 1950, naissent les premiers programmes d'Intelligence Artificielle: - 1956 : "Logic Theorist", un programme de démonstration de théorèmes fondé sur une recherche sélective, de Newell et Simon -1959 : GTP (Système de démonstration de théorèmes géométriques) de Gelernter: programme qui, à partir du théorème à démontrer, remonte par des raisonnements intermédiaires à des théorèmes ou des axiomes connus (proposition évidente en soi). Dans cette continuité, au cours des années 1960, les scientifiques ont développé un certain nombre de programmes capables de résoudre des problèmes d'algèbre, de prévoir la structure des composés de produits chimiques ainsi que de prouver des théorèmes de la géométrie. Les années 1980 marquent un changement important dans l'utilisation de l'IA. En effet, alors que les applications pratiques de l'IA étaient limitées, elles deviennent rapidement très utiles dans les entreprises: analyse de rayons X, réparation d'autres systèmes experts. En outre, le terme apparaît de plus en plus souvent dans le vocabulaire du grand public. Au début de la décennie suivante, on observe la généralisation des ordinateurs de bureau, des réseaux de télécommunications et des matériels incorporant de plus en plus de solutions IA liées à des besoins. De nouvelles techniques de programmation ont évolué ou se sont développées grâce à l'IA. Le but étant de simuler l'intelligence, certains programmes s'inspirent du fonctionnement des neurones dans le cerveau humain. En 1996/1997, la retentissante victoire des échecs d'IBM avec Deep Blue battant le champion du monde Kasparov marque un tournant pour l'IA : c'est la première fois qu'un ordinateur bat officiellement un champion du monde en match singulier à cadence normale de compétition. 1980 à Aujourd'hui : Accélération du mouvement L'efficacité prouvée des systèmes experts entraîne l'augmentation des ventes de matériels utilisant ce système. L'IA commence à se démocratiser pour apparaître dans les grandes firmes (Boeing, General Motors, etc). Face aux détracteurs, les "pro-IA" se défendent : en 1982, Minsky écrit Why People Think Computers Can't, en réponse notamment aux critiques de Dreyfus. De nouvelles branches de l'IA font leur percée sur le marché, notamment celui de la vision de la machine. Par exemple, des travaux sont réalisés sur l'utilisation d'une caméra reliée à un ordinateur pour améliorer le contrôle qualité (Reconnaissance des formes, etc). Malgré quelques échecs, l'IA semble renaître : la logique floue est conçue, les réseaux de neurones sont réhabilités. Durant les années 80, l'IA est sortie des laboratoires pour montrer ses utilisations possibles dans la vie réelle. Mais la recherche continue, et de grands projets ont vu le jour au début des années 90. En 2008, un film intitulé WALL-E sort au cinéma réalisé par un certain Andrew Stanton. Il est intéressant de noter que ce film mise sur plusieurs sujets en lien avec l'intelligence artificielle, comme l'évolution de la planète lié à l'activité humaine ou l'évolution globale des technologies en vue de facilité toute les tâches de la vie quotidienne. On y retrouve d'ailleurs des clins d'oeils à 2001, L'Odyssée de l'espace. |